OpenAI anuncia que recibirá inversiones por 110,000 millones de dólares

Amazon invertirá 50,000 millones de dólares en OpenAI en una alianza estratégica histórica, informó también este viernes

El pionero de la inteligencia artificial OpenAIanunció este viernes que completó una ronda de financiación récord de 110,000 millones de dólares con tres gigantes tecnológicos, lo que eleva su valoración total a 730,000 millones de dólares.

Amazoninvirtió 50.000 millones de dólares en el creador de ChatGPT, mientras que el especialista en chipsNvidia y el japonés Softbank aportaron cada uno 30,000 millones. OpenAI ya tiene previsto recibirnuevas inversiones para completar esta ronda de financiación.

Las masivas inversiones en infraestructura de IA sostienen el crecimiento de EE. UU.

Amazon y OpenAI en una alianza estratégica histórica

El gigante del comercio electrónico y servicios en la nube Amazon y la firma de inteligencia artificial OpenAI han anunciado este viernes una alianza estratégica plurianual que incluye una inversión de 50,000 millones de dólares (42,396 millones de euros) por parte de Amazon, destinada a acelerar la innovación en IA generativa a escala global.

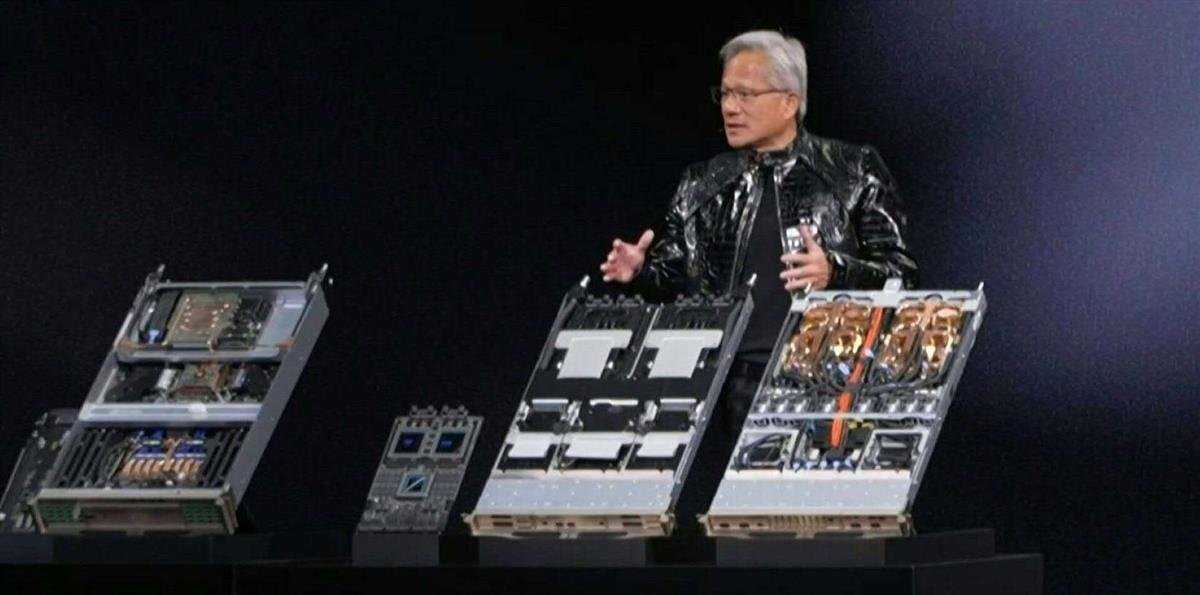

La competencia con Nvidia

En sus instalaciones de Austin, Texas, en el sur de Estados Unidos, ingenieros y técnicos de Annapurna Labs -subsidiaria de Amazon (AWS)- ponen a prueba la resistencia de su chip Trainium 3, disponible en el mercado desde diciembre de 2025.

Texas se ha vuelto un destino clave para empresas de IA por sus bajos costos operativos, abundante energía y políticas favorables a los negocios. Esto ha impulsado el crecimiento de centros tecnológicos fuera de Silicon Valley

En otras instalaciones cercanas, operarios protegen sus oídos mientras se desplazan entre los racks que alojan a los ruidosos UltraServer con los chips Trainium 3, que son sometidos a pruebas antes de entregarse a los clientes.

Desde su primera versión lanzada en 2020, el Trainium 3, la más reciente, es de un tamaño un poco menor al de una tarjeta de crédito.

"Puede reducir los costes de entrenamiento e inferencia hasta un 30-40% en comparación con las alternativas de GPU [procesador gráfico]. Esto se traduce en un menor coste para nuestros clientes y un mejor rendimiento", dice a la AFP el director del laboratorio de IA en Austin, Kristopher King.

Para que un sistema de seguridad reconozca rostros, un auto sin piloto advierta los peligros con precisión, ChatGPT responda claro y con rapidez o se traduzca una voz en vivo, se necesita de una IA cada vez más entrenada.

Y los chips -fabricados habitualmente de silicio con un circuito electrónico integrado- permiten entrenar a la máquina, soportando millones de cálculos matemáticos por segundo, invirtiendo energía y tiempo.

¿Cómo funciona?

"El entrenamiento de IA consiste en cientos de miles de chips trabajando simultáneamente en un sistema de alta disponibilidad, y entrenándose durante varias semanas. Si algo falla o no está disponible durante ese tiempo, tienen que reiniciar desde el último punto guardado o empezar de cero", explica el director de Ingeniería en AmazonAnnapurna Labs, Mark Carroll

Carroll detalla que Anthropic -empresa estadounidense de IA y el mayor cliente de Trainium- solicita principalmente más rendimiento y menor coste.

¿Por qué uno propio?

Algunas compañías han preferido tercerizar sus chips para entrenar a su propia inteligencia artificial, optando principalmente por Nvidia. Pero Amazon también quiso tener su propia alternativa.

"Decidimos fabricar nuestro propio chip para poder integrar verticalmente la arquitectura personalizada del chip con el software, ya sea para AWS Bedrock [plataforma de IA para empresas] o para un cliente que utilice nuestra interfaz Neuron Kernel [software para los chipsTrainium]", detalla King.

"Personalizamos el software, el hardware en nuestros centros de datos, el rack, los servidores y los chips. Esto se traduce en el mejor rendimiento para el cliente", explica

AWS, el principal proveedor mundial de servicios de computación en la nube, no vende sus chipsTrainium a terceros. Solo están disponibles para sus clientes.

¿A qué ritmo?

Amazon describe su chip Trainium como una pequeña ciudad: el hardware es el entorno construido, el flujo de datos es el movimiento de bienes y personas, y la energía se envía donde se necesita mediante una red subterránea.

Dado el flujo de demanda, la firma ya trabaja en su Trainium 4, que espera "tenga un rendimiento de procesamiento seis veces superior (FP4) al del Trainium 3 actual", comenta Carroll.

"Cada generación se comercializa más rápido. Empezamos lanzando nuestra primera generación, que tardó entre 15 y 18 meses. Nuestra segunda generación tardó nueve meses, y estamos intentando mantener ese ritmo para lanzar la tecnología más reciente al mercado lo antes posible", agrega.

King, responsable del laboratorio en Austin, recuerda que el producto ya ha sido anunciado, pero aún no hay fecha delanzamiento.